OpenClaw e l'evoluzione della sicurezza agentica: il nuovo approccio al sandboxing

OpenClaw e l'evoluzione della sicurezza agentica: il nuovo approccio al sandboxing

Il tool di automazione agentica open source, recentemente nell'occhio del ciclone a causa di indagini su potenziali rischi di sicurezza legati all'autonomia decisionale, trova un nuovo assetto grazie all'introduzione di uno stack dedicato da parte di NVIDIA. Questa integrazione conferisce al sistema diversi livelli di sicurezza aggiuntivi e una serie di ottimizzazioni che ne permettono l'utilizzo anche da parte di utenti meno esperti, attraverso una sandbox sicura e controllata.

Qual è la notizia

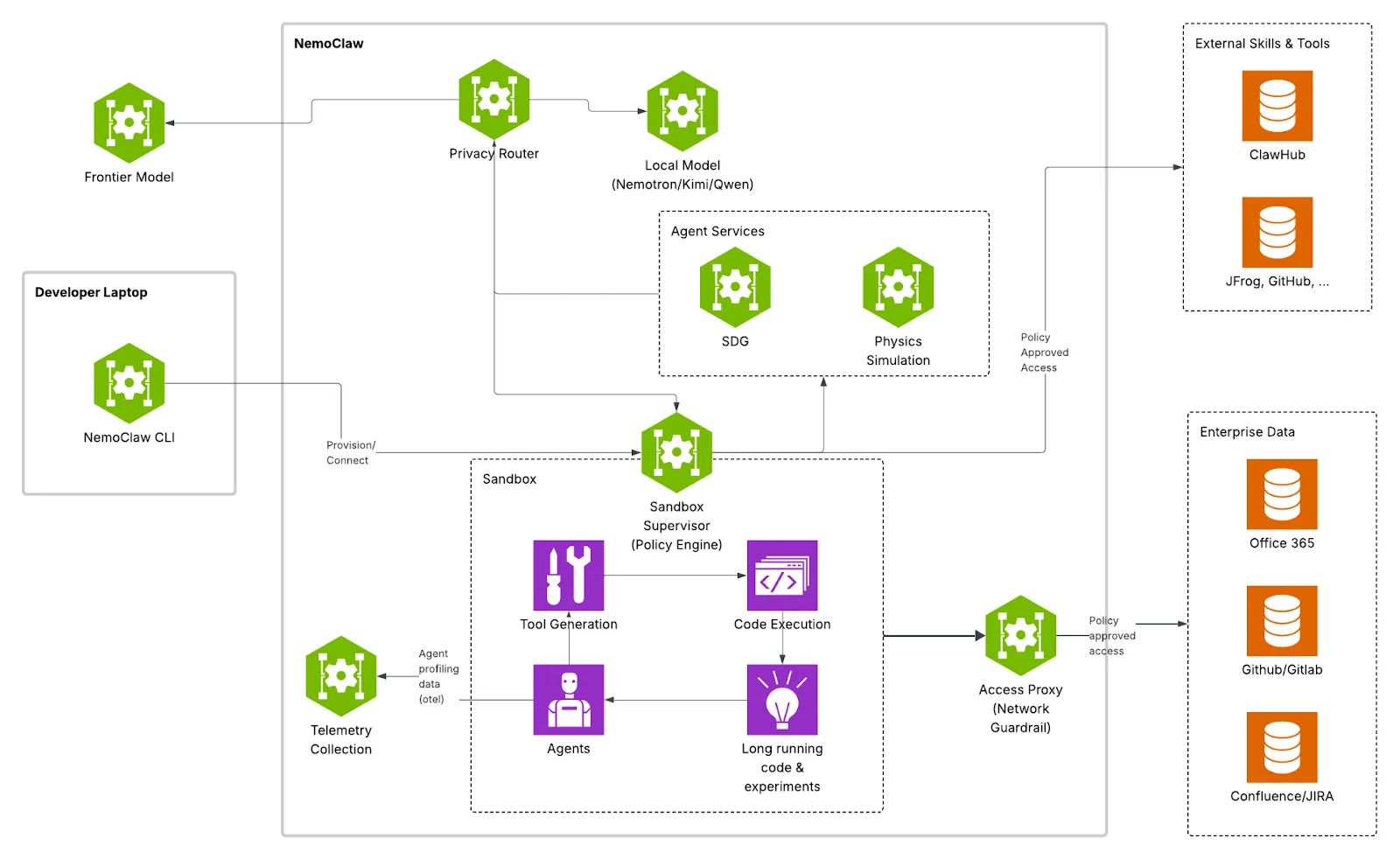

Il recente rilascio di NemoClaw e della tecnologia OpenShell introduce uno stack open source pensato per racchiudere OpenClaw all'interno di un ambiente isolato.

Questo runtime nasce per permettere agli sviluppatori di distribuire in sicurezza agenti IA autonomi, definiti "claws". L'obiettivo tecnologico principale è consentire di sfruttare l'enorme produttività di questi agenti capaci di auto-evolversi, mantenendo contemporaneamente un rigoroso controllo sulla privacy e sui dati aziendali.

OpenShell mira a superare i limiti dei tradizionali sistemi di controllo introducendo primitive di sicurezza strutturali. Questo approccio garantisce all'agente l'accesso agli strumenti e ai dati necessari per lavorare, mitigando il rischio di compromettere il sistema ospite.

Il cuore dell'architettura si basa sull'applicazione delle policy di sicurezza con un approccio "out-of-process". A differenza delle soluzioni attuali che inseriscono i vincoli di sicurezza (guardrail) e i prompt di sistema all'interno dell'agente stesso — rendendoli inefficaci se l'IA viene compromessa — OpenShell si posiziona come un livello di governance esterno. Ogni sessione è isolata in container specifici e i permessi vengono verificati dal motore di policy in tempo reale, rendendo fisicamente impossibile per l'agente aggirare le restrizioni a livello di infrastruttura.

Ad oggi, l'ecosistema è stato reso interamente open source. Un aspetto tecnologicamente rilevante, e di forte rottura rispetto al tradizionale ecosistema chiuso CUDA, è che l'infrastruttura di orchestrazione non è vincolata all'hardware NVIDIA: la piattaforma consente infatti di gestire gli agenti anche su macchine non dotate di GPU proprietarie, ampliandone drasticamente le possibilità di adozione a livello enterprise (pur richiedendo l'hardware della casa per la piena accelerazione locale).

L'approccio di utilizzo è concepito per abbassare le barriere d'ingresso. Gli sviluppatori possono avviare l'ambiente isolato eseguendo un singolo comando da riga di comando (ad esempio openshell sandbox create), senza dover modificare il codice sorgente dei propri agenti IA.

TLDR;

Il 16 marzo 2026 ha segnato il debutto di NemoClaw e OpenShell, un ecosistema open source che rappresenta un importante passo avanti per far operare agenti IA autonomi in sicurezza. Fino a oggi, lasciare che un'intelligenza artificiale lavorasse da sola significava esporre la propria infrastruttura a rischi considerevoli. Questa tecnologia affronta il problema alla radice: crea una sandbox virtuale con regole ferree gestite all'esterno dell'IA. Questo approccio permette all'agente di auto-evolversi, scrivere codice e completare task complessi arginando la possibilità di esfiltrare dati sensibili o intaccare il sistema ospite.

L'Ecosistema Open Source per l'IA Autonoma

Immaginate di avere un assistente digitale instancabile a cui affidare un intero progetto, lasciandolo lavorare in autonomia per giorni. Fino a poco tempo fa, concedere una simile libertà significava correre il rischio di cancellazioni accidentali o di esposizione di documenti privati. Con questa nuova architettura, si ottiene una vera e propria stanza dei giochi sicura: l'IA ha a disposizione tutti gli strumenti per imparare e produrre, ma si muove in un ambiente che non le permette fisicamente di fare danni all'esterno.

Per gli addetti ai lavori, si tratta di un notevole cambio di paradigma nel deployment. Il valore aggiunto risiede nella facilità di implementazione: basta un singolo comando da terminale per avviare l'infrastruttura, che risulta scalabile in modo identico sia su workstation locali sia su complessi cluster aziendali.

Il Superamento del Limite tra Autonomia e Sicurezza

Quando deleghiamo un compito a un essere umano, ci fidiamo del suo giudizio; con i software tradizionali, ci fidiamo del codice statico. Gli agenti IA moderni, tuttavia, sono per natura imprevedibili e in continua evoluzione. Questa capacità ha reso finora complesso bilanciare efficienza e sicurezza. O si bloccava l'IA costringendo l'utente ad approvare ogni singola azione, o le si dava carta bianca assumendosi il rischio. Oggi, questo compromesso può essere superato: l'agente riceve la libertà operativa di cui ha bisogno all'interno di un perimetro architetturale invalicabile.

Sotto il cofano, l'infrastruttura neutralizza minacce informatiche critiche. Un agente con accesso persistente alla shell rappresenta un'enorme superficie di attacco, dove una semplice "prompt injection" può tramutarsi in un disastro aziendale. La nuova architettura sposta il controllo dalla "buona condotta" algoritmica ai vincoli di infrastruttura del sistema ospite, impedendo escalation di privilegi non volute.

L'Approccio "Out-of-Process": Una Sicurezza Invalicabile

Pensate a come funzionano le porte blindate di una banca. Se i controlli di sicurezza fossero gestiti dalla stessa persona che sta prelevando, il sistema fallirebbe. Fino ad oggi, i "paletti" delle IA erano scritti all'interno del loro stesso modello logico; se l'IA veniva ingannata, quei paletti crollavano. Il salto in avanti di questa architettura sta nello spostare le serrature all'esterno: non importa quanto l'agente venga manipolato, le regole sono gestite da un livello di astrazione esterno e incorruttibile.

Tecnicamente si parla di "out-of-process policy enforcement". Mentre strumenti popolari si affidano a system prompt interni, OpenShell avvolge l'agente in un livello di governance separato dal processo dell'LLM. Le sessioni sono isolate a livello di kernel e i permessi verificati in millisecondi prima che l'azione avvenga a livello di sistema operativo.

Sandboxing Avanzato e Controllo Granulare

Quando scarichiamo un'app sullo smartphone, il sistema avvisa se questa cerca di accedere alla fotocamera. Il nuovo stack agisce in modo esponenzialmente più profondo. Se l'IA cerca di scaricare un pacchetto da internet, la rete interviene analizzando il binario e la destinazione. In questo modo l'IA può acquisire nuove competenze, ma il rischio di installare software malevolo è neutralizzato dal policy engine.

Non si tratta di semplici container Docker generici, ma di un motore progettato specificamente per le dinamiche degli LLM, che opera simultaneamente a livello di file system, di rete e di processo. Se un agente tenta di chiamare un'API non autorizzata, la richiesta viene bloccata, ma il sistema permette all'agente di "ragionare" sul blocco e proporre allo sviluppatore umano un aggiornamento della policy.

Privacy Intelligente e Flessibilità Totale

Le aziende sono spesso restie a condividere segreti industriali con intelligenze artificiali connesse in cloud. Per risolvere questo limite, il sistema introduce un "vigile urbano" della privacy.

Il privacy router integrato smista il carico di lavoro agendo esclusivamente sulle direttive aziendali, non su quelle dell'agente. Può indirizzare dinamicamente le richieste verso modelli eseguiti in locale per i dati sensibili e verso modelli esterni di frontiera solo per le interrogazioni generiche, ottimizzando le risorse e mettendo in cassaforte le informazioni riservate. Inoltre, l'intero stack è model-agnostic: i team possono integrarlo in qualsiasi flusso di lavoro preesistente, senza dover riscrivere il codice dei propri agenti.