OpenAI rilascia GPT-5.4

OpenAI rilascia GPT-5.4

Rilasciato il nuovo modello state of the art che porta con sé miglioramenti di performance con un minor numero di interazioni, diventando il nuovo standard di riferimento sia per i task più semplici che per le attività di coding complesse.

Qual è la notizia

OpenAI ha ufficializzato il rilascio di GPT-5.4, disponibile tramite ChatGPT, API e Codex.

Il nuovo modello promette una latenza end-to-end ridotta per le chiamate agentiche multi-step, un minor utilizzo di contesto per l'ottimizzazione dei costi e una migliore comprensione delle istruzioni e della codebase. Questo riduce sensibilmente la necessità di fine-tuning per i prompt e per le direttive da seguire.

Secondo la documentazione ufficiale, oltre a rimpiazzare gpt-5.2 come modello predefinito nell'interfaccia web e gpt-5.3-codex su Codex, gpt-5.4 diventa anche la scelta di default per l'utilizzo via API.

Risulta inoltre migliorata e ottimizzata la capacità di ricerca attraverso il tool_search, che ora recupera esclusivamente le informazioni essenziali, limando ulteriormente l'accuratezza nella selezione degli strumenti in base alle istruzioni fornite.

Tra le novità introdotte, allineandosi a quanto già visto sui modelli concorrenti, GPT-5.4 amplia la finestra di contesto a 1 milione di token (con un pricing separato in base all'utilizzo, consultabile qui). Rende inoltre nativa la funzione di Computer Use (ovvero la capacità di interagire direttamente col software attraverso l'interfaccia utente) per l'esecuzione dello sviluppo secondo un pattern build-run-verify-fix, e introduce la compattazione automatica del contesto per ottimizzare le sessioni di coding.

TLDR;

Il nuovo modello

GPT-5.4 è la nuova ammiraglia messa a disposizione da OpenAI per coprire uno spettro che va dai task più complessi alle operazioni quotidiane più rapide.

Su ChatGPT, il modello è impostato come default per le nuove conversazioni. Come per i suoi predecessori, rimane la possibilità di selezionare la modalità Pro per sfruttare capacità di ragionamento avanzate e risolvere quesiti più articolati.

Sul fronte API, è possibile selezionare quattro diverse versioni:

| Variante | Caso d'uso |

gpt-5.4 | Task generici, ragionamento complesso, conoscenza generale e operazioni agentiche multi-step. |

gpt-5.4-pro | Problemi ostici che richiedono più tempo per essere risolti e un ragionamento profondo. |

gpt-5-mini | Ragionamento e chat ottimizzati per i costi; bilancia velocità, spesa e capacità. |

gpt-5-nano | Task ad alto throughput, in particolare per l'esecuzione di istruzioni dirette o classificazione. |

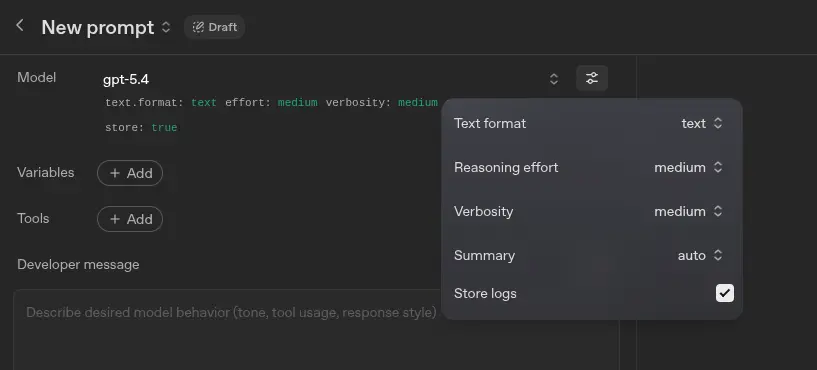

Tra le opzioni di configurazione, analogamente ai modelli precedenti, è possibile mitigare l'effort riservato al ragionamento e impostare la verbosità di risposta (limitando di conseguenza l'utilizzo di token), sia a livello di istruzioni di sistema che di user prompt. Questo parametro influisce direttamente sulla qualità dell'output: per un task di coding, una verbosità ridotta produrrà codice più compatto; al contrario, aumentando il margine a disposizione del modello, questo tenderà a produrre codice più strutturato e ampiamente commentato.

Finestra di contesto da 1M di token

L'introduzione di una context window così ampia permette a GPT-5.4 di operare con limiti molto più generosi, raccogliendo un volume maggiore di informazioni sul task da eseguire (consentendo, ad esempio, istruzioni molto lunghe, l'ingestione di documentazione estesa e l'analisi di intere codebase).

Sebbene non vi siano comunicazioni ufficiali circa la necessità di sottoscrivere un piano specifico per sfruttare appieno questa capienza, per l'utilizzo tramite Codex viene suggerita una configurazione personalizzata. In particolare, è richiesto di regolare i parametri model_context_window e model_auto_compact_token_limit, tenendo presente che si tratta attualmente di un'opzione sperimentale.

Utilizzo dei tool

Il nuovo modello rende built-in il tool di Computer Use, uno strumento fondamentale che permette all'AI di interagire direttamente con l'interfaccia grafica per quelle attività che richiedono operazioni specifiche (ad esempio, la navigazione all'interno di un browser).

È un caso d'uso particolarmente utile per i workflow in cui l'esecuzione di un task si completa con la compilazione di un form web, o quando è necessario analizzare screenshot per individuare bug visivi.

In questo repository sono riportati alcuni scenari di esempio e un'applicazione dimostrativa su come integrare lo strumento Computer Use all'interno di un flusso di lavoro automatizzato.

Guida alla migrazione

Sebbene gpt-5.4 rappresenti un sostituto quasi universale dei precedenti modelli flagship, ci sono alcune dinamiche a cui prestare attenzione in caso di migrazione da versioni meno recenti.

In generale, OpenAI suggerisce di iniziare regolando l'effort di reasoning per trovare un livello di output che si allinei a quello ottenuto in passato. È inoltre disponibile un Prompt Optimizer (richiede l'autenticazione con un account OpenAI) che adatta automaticamente i vecchi prompt alle regole interne della versione 5.4.

Di seguito, un rapido riferimento per l'adattamento:

- gpt-5.2:

gpt-5.4con le impostazioni di default è sufficiente per la sostituzione diretta. - o3:

gpt-5.4con ragionamento impostato sumediumohigh. È consigliabile testare prima sumediume passare adhighsolo se i risultati non soddisfano pienamente le aspettative. - gpt-4.1:

gpt-5.4con ragionamento disabilitato (none). Partendo danone, si consiglia di ottimizzare i prompt per il nuovo modello; se insufficiente, aumentare progressivamente l'effort di ragionamento. - o4-mini o gpt-4.1-mini:

gpt-5-miniaccompagnato da un buon prompt tuning rappresenta un rimpiazzo più che valido. - gpt-4.1-nano:

gpt-5-nanocon prompt tuning garantisce una transizione fluida.